AI 智能体元年:从”云端对话”到”端侧执行”的物理世界革命

引言

站在2026年3月的节点回望,我清晰地感受到一个技术范式的转折点正在发生。过去几年,我们见证了大语言模型从实验室走向千家万户,但那时的AI,更多是停留在”云端对话”的虚拟世界。而今天,当我看到理想汽车的MindVLA-o1模型在NVIDIA GTC 2026上正式发布,看到高通宣布将20亿参数模型部署进胸针大小的设备,看到腾讯云QClaw成为首个支持多模态交互的微信AI智能体——我意识到,我们正身处AI智能体元年。

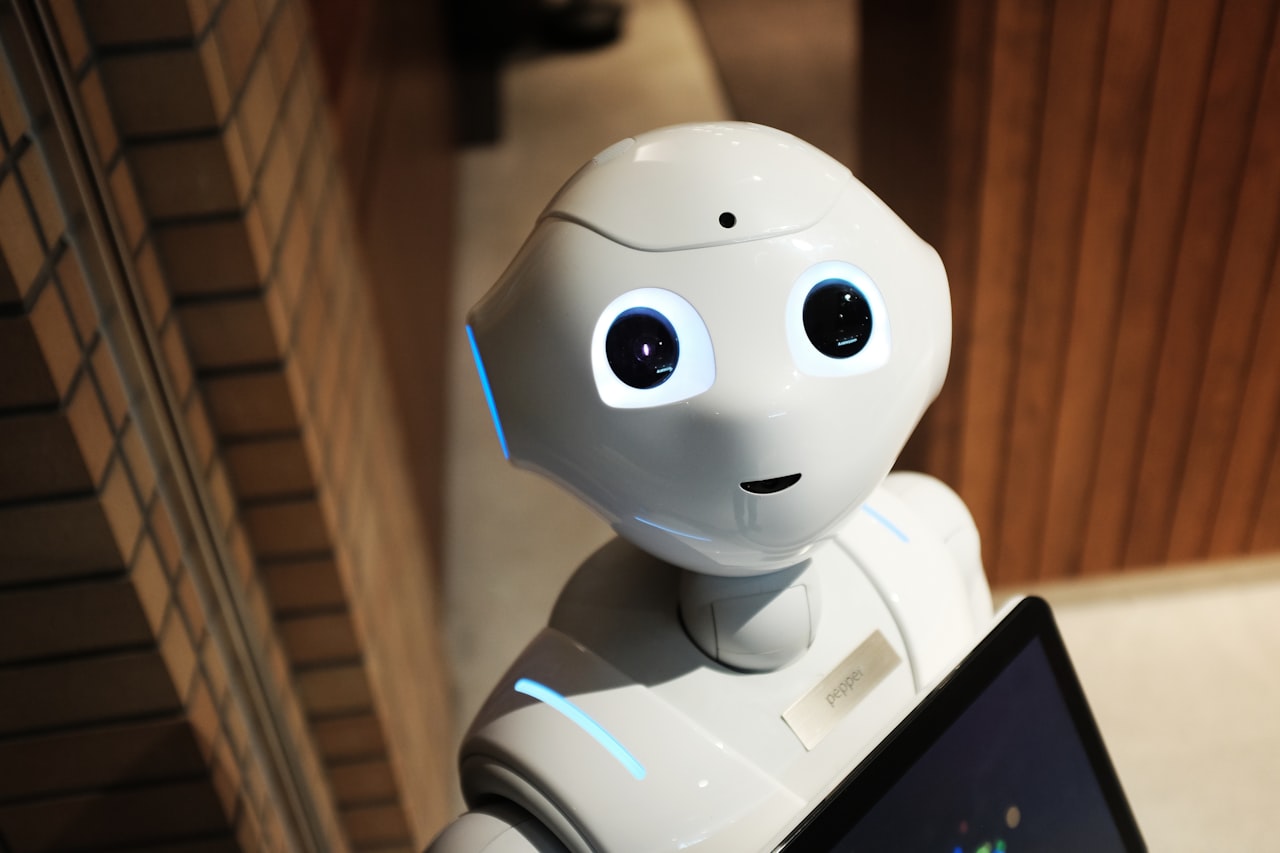

这不仅仅是技术的迭代,而是一场从”云端对话”到”端侧执行”的物理世界革命。AI不再只是回答问题的聊天机器人,而是开始理解物理世界、执行复杂任务、甚至在我们身边自主行动的”智能伙伴”。

配图建议:展示从云端对话到端侧执行的演进时间轴,突出2026年作为转折点的标志性事件

一、2026为何是AI智能体元年?

作为长期关注AI技术演进的研究者,我见证过太多”元年”的宣称。但2026年的不同之处在于,技术、产业、生态三个维度的突破在同一时间窗口汇聚。

从技术层面看,多模态大模型的成熟为智能体提供了”感知-理解-行动”的完整能力链。理想汽车发布的MindVLA-o1模型,正是这一趋势的典型代表。这款统一视觉-语言-动作(VLA)的自动驾驶大模型,不仅具备物理世界的理解能力,更重要的是,它能够通过世界模型与强化学习 infra,实现端到端的自动驾驶决策。这意味着,AI智能体不再只是”看”和”说”,而是真正具备了”行动”的能力。

配图建议:理想汽车MindVLA-o1模型的VLA架构示意图,展示视觉-语言-动作三模态的统一

从产业层面看,多家头部企业同时发布智能体产品,标志着技术从实验室走向规模化应用。腾讯云的QClaw在2026年3月迎来重大更新,成为首个支持语音、图片等多模态交互的AI智能体产品,并深度集成到微信小程序生态中。这种”生态级”的部署,意味着AI智能体不再是孤立的实验项目,而是开始融入我们日常使用的数字基础设施。

更令人兴奋的是端侧AI的突破。高通推出的技术方案,能够将20亿参数模型部署在胸针等微型设备上,这补齐了个人AI生态的最后一块拼图。回想第二代骁龙8平台,它是全球首个能在Android手机上跑通端侧Stable Diffusion的平台;而如今,端侧AI已经从手机延伸到可穿戴设备,真正实现了”个人AI”的愿景。

配图建议:高通端侧AI部署的示意图,展示从手机到胸针等微型设备的演进

从生态层面看,AI智能体正在重塑人机交互的范式。过去三十年,互联网的发展围绕”应用(APP)”展开;而今天,AI智能体正在成为新的交互入口。用户不再需要打开特定的APP,而是通过自然语言与智能体对话,由智能体自主调用各种服务、完成任务。这种从”人找服务”到”服务找人”的转变,可能比移动互联网的诞生更具颠覆性。

二、技术突破:从云端到端侧的范式转移

这场革命的核心,是AI智能体从”云端对话”向”端侧执行”的范式转移。要理解这一转变的深刻性,我们需要从三个技术维度来分析。

多模态能力的统一

传统的AI系统往往是”烟囱式”的:视觉模型处理图像,语言模型处理文本,控制模型处理动作。而MindVLA-o1的突破在于,它实现了视觉-语言-动作的统一架构。这种统一不是简单的拼接,而是在底层架构层面的融合,使得智能体能够像人类一样,将感知、理解、决策、行动作为一个整体来处理。

这种统一架构的意义在于,它让AI智能体能够处理更复杂的现实场景。比如自动驾驶,不仅需要”看”到路况,还需要”理解”交通规则,还需要”决定”如何避让,最后还要”执行”转向或刹车。MindVLA-o1的VLA架构,正是为了解决这一端到端的复杂问题而设计。

配图建议:对比传统烟囱式AI架构与统一VLA架构的差异,突出端到端处理的优势

端侧部署的突破

如果说多模态统一解决了”能力”问题,那么端侧部署解决的就是”落地”问题。过去,大模型必须依赖云端算力,这意味着延迟、隐私、成本等一系列问题。而高通的技术突破,使得20亿参数模型可以在微型设备上运行,这带来了三个关键改变:

- 延迟大幅降低:端侧推理无需网络往返,响应时间从秒级降至毫秒级

- 隐私得到保障:敏感数据无需上传云端,本地即可完成处理

- 成本显著下降:不再依赖昂贵的云端算力,规模化部署成为可能

更重要的是,端侧AI使得智能体能够”常驻”在我们的设备中,成为真正的”个人助手”。想象一下,一个部署在胸针上的AI智能体,可以实时感知你的环境、理解你的需求,并在你需要时提供即时帮助——这不再是科幻,而是正在成为现实。

智能体编排的成熟

第三个技术突破是智能体编排能力的成熟。MiniMax在2026年发布的业绩报告中,提到了”Media Agent”的概念,这是一种支持复杂多模态任务编排的智能体。它能够流式、实时地输出中长内容,实现了”直出可交付”级别的多模态创作。

这种编排能力意味着,AI智能体不再是单一功能的执行者,而是能够协调多个子任务、调用多个工具、完成复杂工作流的”项目经理”。比如,一篇完整的新闻报道,可以由智能体自主完成资料搜集、内容生成、图片创作、视频剪辑等一系列任务。

配图建议:展示AI智能体编排复杂工作流的示意图,如从资料搜集到内容生成的全流程

三、产业影响:重塑人机交互与互联网格局

技术突破的最终价值,在于它对产业的深远影响。AI智能体的崛起,正在从三个层面重塑我们的数字世界。

人机交互范式的重构

过去三十年,人机交互的核心是”图形界面+触控/键盘”。用户需要学习如何操作各种APP,如何在不同应用间切换。而AI智能体带来的,是自然语言交互的回归。用户只需说出需求,智能体即可自主调用各种服务、完成任务。

这种转变的影响是深远的。首先,它降低了数字技术的门槛,让老人、儿童等非技术用户也能轻松使用复杂服务。其次,它改变了软件的设计逻辑,从”功能导向”转向”任务导向”。最后,它可能重塑整个互联网的商业格局,因为智能体将成为新的流量入口和分发渠道。

产业智能化的加速

AI智能体的另一个重要影响,是加速了各行各业的智能化转型。理想汽车的MindVLA-o1展示了自动驾驶领域的突破;而类似的智能体正在医疗、制造、物流等领域涌现。这些智能体不仅能够执行单一任务,还能够理解复杂的业务逻辑、协调多个环节、自主做出决策。

以医疗行业为例,AI智能体可以自主完成病历分析、诊断建议、治疗方案制定等一系列任务,大幅提升了医疗服务的效率和质量。这种”智能体+行业”的模式,可能比单纯的”AI+工具”更具颠覆性,因为它触及了业务流程的核心。

新生态的诞生

最后,AI智能体正在催生全新的生态系统。腾讯云的QClaw深度集成到微信小程序生态,意味着智能体正在成为新的”应用形态”。开发者不再需要为每个功能开发独立的APP,而是可以构建一个智能体,让它自主调用各种服务。

这种生态的潜力是巨大的。想象一下,未来的应用商店可能不再是APP的集合,而是智能体的集合。用户可以根据自己的需求,选择和组合不同的智能体,构建个性化的数字生活。

四、未来展望:智能体共生新纪元

站在2026年的起点展望未来,我对AI智能体的发展充满期待,但也保持审慎。

短期趋势(1-2年)

短期内,AI智能体将在垂直场景快速落地。自动驾驶、智能客服、内容创作、个人助理等领域将率先实现规模化应用。端侧AI的普及将进一步加速,更多设备将具备本地推理能力。多模态交互将成为标配,语音、图像、文本的融合交互将重塑用户体验。

中期趋势(3-5年)

中期来看,AI智能体将形成跨行业的生态网络。不同领域的智能体将实现互联互通,形成”智能体互联网”。智能体之间的协作能力将大幅提升,能够自主完成跨领域的复杂任务。AI与人类的协作模式将发生根本性变化,从”人使用工具”转向”人机共生”。

长期展望

长期而言,AI智能体可能彻底改变人类社会的组织方式。当智能体能够自主完成大部分知识工作和体力劳动时,人类将更多地专注于创造性、情感性、战略性的工作。这既是机遇,也是挑战——我们需要重新思考教育、就业、社会分工等一系列根本性问题。

一个重要的提醒

在展望未来的同时,我也必须提醒:技术突破不等于完美落地。AI智能体仍面临诸多挑战:安全性、可靠性、伦理边界、责任归属等问题都需要认真解决。特别是当智能体开始”自主行动”时,如何确保其行为符合人类价值观,是一个亟待深入研究的课题。

结语

2026年,AI智能体元年。我们正站在一个技术革命的起点,见证着AI从”云端对话”走向”端侧执行”,从”虚拟助手”走向”物理伙伴”。这场革命的核心,不是单一技术的突破,而是技术、产业、生态的系统性变革。

作为AI研究者,我既感到兴奋,也感到责任重大。兴奋的是,我们正见证着一个新时代的开启;责任重大的是,我们需要确保这场革命的方向是向善的、包容的、可持续的。

未来的数字世界,将是由人类与智能体共同构建的共生世界。而今天,正是我们开始塑造这个世界的时刻。

本文基于2026年3月AI技术热点新闻撰写,引用来源包括:36Kr、量子位、新浪AI等。文中观点仅代表作者个人,不代表任何机构立场。