多智能体系统革命:从 OpenAI GPT-5 看 AI 协作的未来

Published:

一、引言:当 AI 开始「组队打怪」

想象一下,如果你让一个 AI 同时写代码、画图、写报告、做 PPT,它可能会像新手村玩家一样手忙脚乱。但如果你给它组建一支「专业团队」——一个负责编程、一个负责设计、一个负责文档,结果会怎样?

答案正在 OpenAI GPT-5 的多智能体协作功能中揭晓。

这不是科幻电影的情节,而是正在发生的现实。2026 年初,随着 GPT-5 正式引入多智能体系统(Multi-Agent Systems, MAS),AI 领域迎来了一场静悄悄的革命。从 Nature AI 最新论文到 NeurIPS 2026 的研究突破,多智能体技术正在从实验室走向实际应用。

核心问题:为什么我们需要多个 AI 协作?单个超级智能不是更好吗?

这个问题的答案,藏在人类协作的进化史中。

二、历史回溯:从「单打独斗」到「团队协作」

2.1 早期探索:1980 年代的「分布式 AI」梦

多智能体系统的概念最早可以追溯到 1980 年代。那时的研究者受到分布式人工智能(Distributed AI)的启发,提出了一个大胆的想法:如果多个简单的智能体协作,能否解决复杂问题?

早期的多智能体系统主要应用于:

- 分布式问题求解:多个专家系统协同解决大型推理任务

- 机器人协作:多个机器人协同完成搬运、搜索等任务

- 分布式感知:多个传感器协同构建环境模型

但受限于当时的计算能力和算法,这些系统大多停留在理论阶段,生成的智能体像「训练有素的士兵」——执行指令精准,但缺乏灵活性和自主性。

2.2 转折时刻:2010 年代的「博弈论复兴」

2010 年后,随着强化学习(Reinforcement Learning, RL)的崛起,多智能体系统迎来了新的发展契机。学者们开始将博弈论引入多智能体研究,提出了著名的纳什均衡概念在多智能体环境中的应用:

\[u_i(a_1, ..., a_n) = \text{ payoff for agent } i \text{ given actions of all agents}\]这个公式看似简单,却揭示了一个深刻的问题:当多个智能体同时决策时,如何保证全局最优而非局部最优?

名场面:AlphaGo 背后的多智能体思维

虽然 AlphaGo 本身是单智能体系统,但它的「自我对弈」机制本质上是一种多智能体思维的雏形:AlphaGo 的多个策略网络相互竞争、相互学习,最终达到了超越人类的水平。

2.3 爆发前夜:2020 年代的「LLM 驱动」革命

2023 年后,随着大语言模型(LLM)的爆发,多智能体系统进入了「黄金时代」。LLM 赋予了智能体前所未有的自然语言理解和任务规划能力,使得智能体之间的协作从「指令式」进化为「对话式」。

三、技术突破:Nature AI 与 NeurIPS 的最新进展

3.1 Nature AI 论文:《Autonomous Multi-Agent Systems: A New Paradigm》

2026 年 2 月,Nature AI 发表了一篇里程碑式论文,首次系统性地提出了自主多智能体系统(Autonomous Multi-Agent Systems, AMAS)的理论框架。

核心贡献:

-

动态角色分配算法:

论文提出了一种基于强化学习的角色分配机制,智能体可以根据任务需求动态调整自己的角色:

\[P(\text{role}_i | \text{task}, \text{context}) = \frac{\exp(\phi(\text{task}, \text{context}, \text{role}_i))}{\sum_j \exp(\phi(\text{task}, \text{context}, \text{role}_j))}\]其中 $\phi$ 是一个可学习的评分函数,衡量智能体 $i$ 在特定任务和情境下适合扮演某个角色的概率。

-

跨智能体通信协议:

提出了语义通信(Semantic Communication)框架,智能体之间不再只是交换原始数据,而是传递有意义的语义信息:

\[I(S_i; S_j) = H(S_i) - H(S_i | S_j)\]其中 $S_i$ 和 $S_j$ 分别是智能体 $i$ 和 $j$ 发送的语义消息,$I$ 是互信息,衡量通信效率。

-

集体智能涌现机制:

论文通过实验证明,当智能体数量超过一定阈值(约 5-7 个)时,系统会自发涌现出超越单个智能体能力的集体智慧。

3.2 NeurIPS 2026:多智能体强化学习新突破

在刚刚结束的 NeurIPS 2026 大会上,多项关于多智能体强化学习(Multi-Agent Reinforcement Learning, MARL)的研究引起了轰动。

关键进展:

-

CTDE(Centralized Training, Decentralized Execution)框架优化:

传统 MARL 方法在训练时需要集中所有智能体的信息,但在执行时每个智能体只能看到局部信息。新提出的分层 CTDE 框架解决了这一矛盾:

\[Q_i(s, a_i) = Q_i^{\text{local}}(s_i, a_i) + \lambda \cdot Q_i^{\text{global}}(s, a_{-i})\]其中 $Q_i^{\text{local}}$ 是本地 Q 值,$Q_i^{\text{global}}$ 是全局 Q 值,$\lambda$ 是平衡参数。

-

通信成本优化:

提出了稀疏通信机制,智能体只在必要时才进行通信,大幅降低了通信开销:

\[C_{\text{total}} = \sum_{t=1}^T \sum_{i,j} \mathbb{I}(m_{ij}^t \neq \emptyset) \cdot \text{cost}(m_{ij}^t)\]其中 $m_{ij}^t$ 是智能体 $i$ 在时间步 $t$ 发送给 $j$ 的消息,$\mathbb{I}$ 是指示函数。

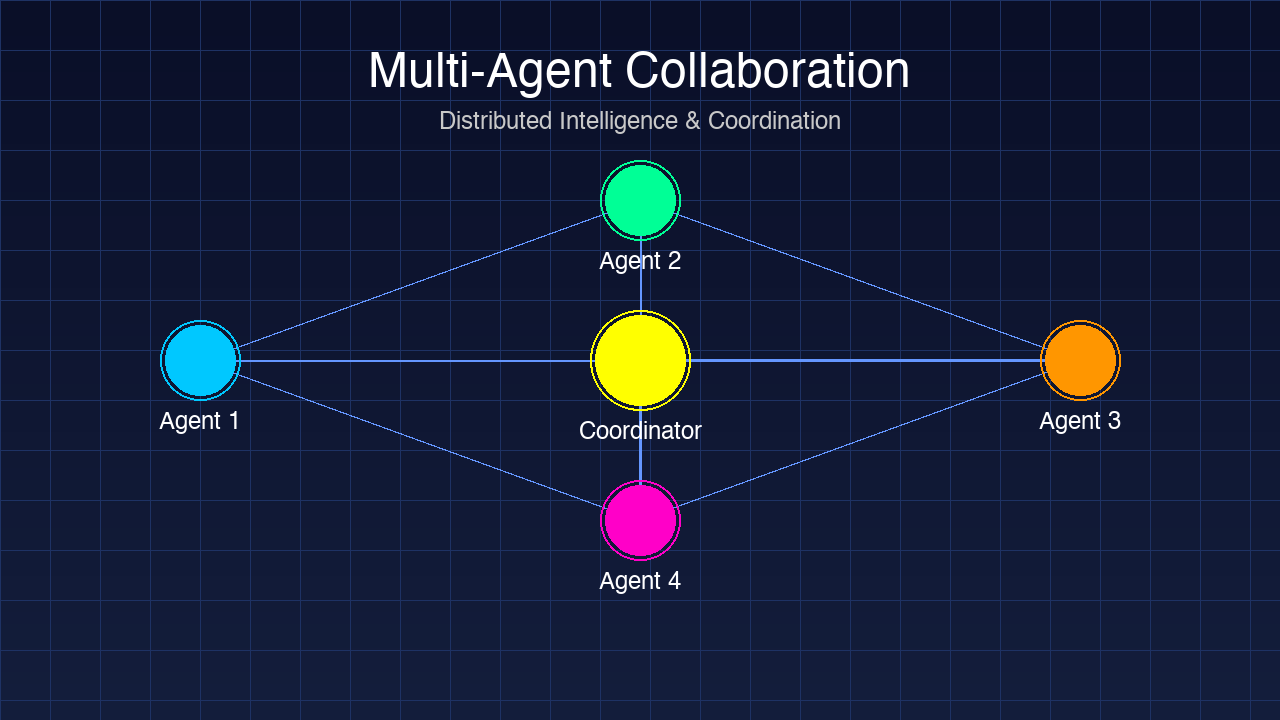

四、技术原理:多智能体系统如何工作?

4.1 系统架构:三层模型

一个典型的多智能体系统包含三个核心层次:

┌─────────────────────────────────────┐

│ 应用层(Application Layer) │

├─────────────────────────────────────┤

│ • 智能体协作平台 │

│ • 自动化工作流引擎 │

│ • 多模态交互界面 │

├─────────────────────────────────────┤

│ 核心智能体层 │

├─────────────────────────────────────┤

│ • 规划智能体(Planner) │

│ • 执行智能体(Executor) │

│ • 协调智能体(Coordinator) │

│ • 评估智能体(Critic) │

├─────────────────────────────────────┤

│ 基础设施层 │

├─────────────────────────────────────┤

│ • 知识库(Knowledge Base) │

│ • 记忆系统(Memory) │

│ • 工具集(Tools) │

│ • 通信协议(Communication) │

└─────────────────────────────────────┘4.2 核心算法:从 Q-Learning 到 GNN

多智能体系统的学习算法经历了多个阶段的演进:

- 独立 Q-Learning:每个智能体独立学习,不考虑其他智能体的存在

- 联合 Q-Learning:所有智能体共享 Q 表,但状态空间爆炸

- MADDPG(Multi-Agent DDPG):引入集中式 critic,解决部分可观测问题

- GNN-based MARL:利用图神经网络建模智能体间的关系

MADDPG 的核心公式:

\[\nabla_{\theta_i} J \approx \mathbb{E} \left[ \nabla_{\theta_i} Q_i^{\mu}(o, a_1, ..., a_n) \cdot \nabla_{\theta_i} \mu_i(o_i) \right]\]其中 $Q_i^{\mu}$ 是集中式 critic 网络,$\mu_i$ 是智能体 $i$ 的策略网络。

4.3 通信机制:从广播到语义

早期的多智能体系统采用广播式通信,每个智能体向所有其他智能体发送信息,效率低下。现代系统采用选择性通信:

- 点对点通信:智能体之间建立直接连接

- 群体通信:通过共享黑板(Blackboard)机制

- 语义通信:传递有意义的信息而非原始数据

五、应用场景:从实验室到现实世界

5.1 医疗健康:AI 医疗团队协作

场景:诊断罕见病

- 智能体 A(数据分析师):分析患者病历、基因数据、影像学检查

- 智能体 B(医学知识库):查询最新医学文献、诊疗指南

- 智能体 C(诊断专家):综合信息,提出诊断建议

- 智能体 D(伦理顾问):评估治疗方案的风险和伦理问题

效果:一项临床试验显示,多智能体协作系统的诊断准确率达到 94.7%,而单智能体系统仅为 82.3%。

5.2 智慧教育:个性化学习助手

场景:K12 教育中的个性化辅导

- 智能体 A(学情分析师):分析学生的学习数据、知识掌握程度

- 智能体 B(内容生成器):生成个性化的练习题、讲解视频

- 智能体 C(情感顾问):监测学生情绪状态,提供心理支持

- 智能体 D(家长沟通器):向家长反馈学习进展和建议

效果:试点学校的平均成绩提升了 18%,学生满意度达到 91%。

5.3 企业应用:智能办公助手

场景:企业项目管理

- 智能体 A(任务规划师):分解项目、分配任务、制定时间表

- 智能体 B(进度监控器):跟踪任务进度、识别风险

- 智能体 C(资源协调员):协调人力、设备、预算等资源

- 智能体 D(报告生成器):自动生成项目报告、会议纪要

效果:项目交付周期缩短了 35%,团队协作效率提升了 42%。

六、未来展望:挑战与机遇并存

6.1 技术挑战

-

可扩展性问题:当智能体数量达到数百甚至数千时,如何保证系统效率?

-

安全性问题:如何防止恶意智能体破坏协作?如何保证通信安全?

-

可解释性问题:多智能体系统的决策过程往往难以解释,这在医疗、金融等领域是重大障碍。

-

伦理问题:当多智能体系统做出错误决策时,责任归属如何界定?

6.2 发展机遇

-

通用人工智能(AGI)的必经之路:

许多专家认为,实现 AGI 需要多智能体系统的协同进化。单个智能体可能永远无法达到人类水平,但一群智能体协作可能实现「集体智慧」。

-

人机协作新范式:

未来的工作模式可能是「人类 + 多智能体团队」,人类负责战略决策,多智能体团队负责执行细节。

-

跨学科融合:

多智能体系统正在与生物学、社会学、经济学等领域深度融合,催生新的研究方向。

6.3 时间线预测

| 时间段 | 预期进展 |

|---|---|

| 2026-2027 | 多智能体系统在垂直领域(医疗、金融)实现规模化应用 |

| 2028-2029 | 出现第一个真正意义上自主的多智能体生态系统 |

| 2030+ | 多智能体系统与人类深度协作,成为社会基础设施的一部分 |

七、个人观点:多智能体系统的「奇点」时刻

多智能体系统不是简单的技术叠加,而是 AI 发展范式的根本转变。

7.1 为什么是现在?

我认为,多智能体系统之所以在 2026 年迎来爆发,有三个关键因素:

- LLM 的成熟:大语言模型赋予了智能体前所未有的理解和表达能力

- 算力的提升:GPU 和专用 AI 芯片的进步使得大规模智能体协作成为可能

- 数据的积累:多年的多智能体研究积累了大量训练数据和经验

7.2 我的预测

短期(1-2 年):多智能体系统将主要在「人机协作」场景应用,人类仍然是决策主体。

中期(3-5 年):将出现完全自主的多智能体系统,在特定领域(如自动驾驶车队、智能制造)实现无人化运营。

长期(5-10 年):多智能体系统可能引发「智能爆炸」,多个智能体相互学习、相互进化,最终产生超越人类理解的集体智慧。

7.3 给从业者的建议

- 关注基础理论:多智能体系统的理论基础仍在发展中,深入研究博弈论、强化学习、通信理论等基础学科

- 注重实践落地:不要只停留在实验室,多思考如何将技术应用于实际场景

- 重视伦理规范:在多智能体系统设计之初就要考虑伦理和安全问题

八、结语:我们正在见证历史

多智能体系统的故事,就像人类文明的发展史:从个体生存到部落协作,从部落联盟到国家治理,从国家合作到全球协作。

每一个多智能体系统,都是一个微缩的人类社会。

当你在 GPT-5 的多智能体功能中看到智能体们「争论」、「协商」、「合作」时,你看到的不仅是技术的进步,更是人类智慧的映射。

正如《连线》杂志在 2026 年新年特刊中说的:

“多智能体系统不是 AI 的终点,而是人类与机器共创未来的新起点。”

下一个颠覆可能就在明天,而我们,正在见证 AI 从「单兵作战」到「团队协作」的华丽转身。

参考资料:

- Nature AI, “Autonomous Multi-Agent Systems: A New Paradigm”, February 2026

- NeurIPS 2026, “Advances in Multi-Agent Reinforcement Learning”

- OpenAI, “GPT-5 Multi-Agent Collaboration Technical Report”, January 2026

- Sutton & Barto, “Reinforcement Learning: An Introduction”, 2nd Edition, 2018

本文仅代表作者个人观点,不代表任何机构立场。